はじめに

現在、人工知能(Artificial Intelligence:AI)が各分野で注目を浴びている。そして、AIとセキュリティ(安全性)の関係も非常に重要となってきている。AIとセキュリティの関係というとセキュリティ対策にAIを適用することだけを思い浮かべるかもしれないが、安全性を確保するためにはもっと広く検討していく必要があると考えている。

本稿では、セキュリティに脅威を与えるサイバー攻撃の動向を概観したのち、AIとセキュリティの関係を4つの観点から解説する。

サイバー攻撃の動向

サイバー攻撃の猛威が続き、防御する側の状況は厳しさを増してきている。サイバー攻撃の歴史を振り返ると2つのターニングポイントがあったと考えている。最初のターニングポイントは2000年ごろ、第二のターニングポイントは2010年ごろである。それぞれの特徴は表1に示すように整理することができる。第二のターニングポイントでの最大の特徴は、攻撃パターンが不特定多数への攻撃から特定少数を狙う標的型に変わってきた点である。攻撃技術も非常に高度になってきており、従来の攻撃が風邪なら、次のターニングポイント以降の攻撃は新型インフルエンザであると言う人もいるぐらいである。

表1 2つのターニングポイントの比較

|

第一次ターニングポイント

(2000年ごろ) |

第二次ターニングポイント

(2010年以降) |

| 攻撃目的 |

面白半分、主義主張 |

多様化(面白半分、主義主張、金もうけ、国家の指示) |

| 攻撃者 |

ハッカー(クラッカー) |

ハッカー、ハクティビスト、犯罪者、スパイ、軍人 |

| 攻撃対象 |

Webなどの一般IT |

重要情報インフラも<Stuxnet> |

| 攻撃パターン |

不特定多数 |

標的型<Stuxnet、ソニー、三菱重工、日本年金機構> |

| 攻撃技術 |

低~中 |

中~高<Stuxnet、ソニー、三菱重工、農林水産省> |

従来の攻撃が風邪なら、新しい攻撃は新型インフルエンザ

サイバー攻撃に関しては今後 表2のようになっていくと予想している。

表2 サイバー攻撃の今後

- 被害の大型化

仮想通貨システムへの攻撃にみられるように、数百億円の被害になるものも出てきており、今後この傾向は変わることはないと思われる。

- 被害形態の多様化

従来の攻撃は情報漏洩などの機密性の喪失が中心だったのが、ランサムウェアの普及にみられるようにデータの暗号化による完全性や可用性の喪失が問題となるものも増えてきている。

- 攻撃対象の多様化

従来の攻撃はPCなど情報処理機器が中心だったが、IoT(Internet of Things )への攻撃も増加していくと予想される。

AIとセキュリティに関する4つの観点

AIとセキュリティに関しては、次の4つの観点があると考えられる。

なお、ここではAIには機械学習などの技術を含むものとする。以下それぞれについて説明を加える。

- Attack using AIAIを利用した攻撃

- Attack by AIAI自身による攻撃

- Attack to AIAIへの攻撃

- Measure using AIAIを利用したセキュリティ対策

AIを利用した攻撃

今後、AIを利用した不正者によるサイバー攻撃が増加してくると考えられる。特に、AI機能つきのマルウェアは近い将来、確実に誕生するだろう。今後は、小さな種々のAI機能付きマルウェアが侵入し、協力しながら環境に最も適した攻撃をするようになっていくのではないかと考えている。少なくとも研究レベルでは、このような動きを考慮して今後の対策を考えておくことが大切となるだろう。

AI自身による攻撃

AIが人間に及ぼす悪影響で最も大きな問題は人間を上回る能力を有するAIが誕生し将来的に人間が絶滅させられるのではないかということである。

Googleの研究者のレイ・カーツワイルは2045年にはAIの能力が、人間を超越するシンギュラリティが生じ、反乱すら起きるかもしれないとしている(参考文献1)。また、スティーブン・ホーキングは「人工知能の発明は人類史上最大の出来事だった。だが同時に『最後』の出来事になってしまう可能性もある」と言っている(参考文献1)。このような問題を回避するために、AI研究に関し今から規制を設けておくべきであるという意見もある。しかし、多くのAI研究者は人間に対する反乱が起きる可能性は低く、過度の規制が逆にいろいろな問題を生じさせると考えている。

私自身もAIの反乱が生じる可能性は現状では非常に低いと思っている。しかし、人間のリスクへの感性は低いということを知っておいた方がよいだろう。東日本大震災では、津波によって各地に甚大な被害がもたらされた。以前から可能性としては指摘されていたが、東京電力は大きな津波がすぐには来ないだろうと考えた。リスクへの警鐘には謙虚に対応していく必要があると考えており、AIの反乱については今後も関心を持って見ていく必要があるだろう。

AIが人間の仕事を奪ってしまうのではないかと思っている人は多く、AIとロボットが進展することにより次のような職業はなくなっていくと予想している(参考文献2)。

「一般・経理事務員、受付係、クリーニング取次店員、建設作業員、自動車組立工、自動車塗装工、スーパー店員、タクシー運転者、宅配便配達員、電車運転士、路線バス運転者、通関士」ほか。

一方、残る職業としては次のようなものがあるとしている。

「アートディレクター、インテリアコーディネーター、フラワーデザイナー、メークアップアーティスト、映画監督、クラシック演奏家」ほか。

さてどうなるのか。私はスーパーのスーパーな能力を持つ店員などは今後も重宝されるだろうと考えている。一方、平凡な能力しか持たないインテリアコーディネーターなどは淘汰されていくような気がする。

AIへの攻撃

AIのためのシステムへの攻撃による問題を考えておくことも必要である。機械学習システムの停止やファイル情報、通信路情報の盗み出しなどの攻撃は他システムへの攻撃と同じであろう。学習モデルへデータを入出力することによる機械学習システムで使われているデータの推定などは特有の問題として注意する必要がある。また、機械学習に対する偏った訓練データを意図的に与えることが原因で、不適切な判断をさせてしまう問題にも注目する必要がある。例えば、米マイクロソフトのチャットボット「Tay」は、クラウドソーシングを利用していろいろな人から学習させたところ、意図的に多数の偏った入力が行われた結果、ナチスを礼賛したり差別発言を繰り返したりするようになったという(参考文献3)。

適切な学習データをどのように与えるかは、今後も大きな課題になっていくだろう。

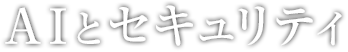

AIを利用したセキュリティ対策

Google Scholarで「Cyber Security AND Artificial Intelligence」をキーワードとして検索すると2007年には1,240件だったものが2017年には8,210件と6.6倍に増加している。「Ryoichi Sasaki」単体ではトータルで17,700件ヒットし、「上記+Ryoichi Sasaki」で検索すると202件がヒットした。なお、これには引用や特許なども含み、姓が「Sasaki」の人と名が「Ryoichi」の人の共同著者の場合も含むため、うち10件程度が私の論文や発表原稿である。

これらの調査やWebサイト上の製品紹介から、図1のようなセキュリティ対策のためにすでにAIが使われていることがわかった。

AIを使ったというセキュリティ対策ツールは各社から発売されており、そのメリットがWebサイト上で述べられている。しかし、セキュリティ対策のためにAIを実際に利用するにあたっては、表3のような問題を解決することが望ましい(参考文献4)。しかし、これらをどのように解決したか言及しているものは少ない。

表3 セキュリティ対策にAIを利用するにあたっての問題

機械学習などのAIシステムは、適切に分類された大規模なデータセットを得ることが望ましいが、この分野でこのようなデータセットを入手するのは一般に困難である。特に、サイバー攻撃は時間とともに特性が変化することが多く、それぞれの期間における大量のデータの入手が必要となるが、困難なことが多い。

機械学習システムは、いくつかのケースの誤検出を代償にして精度を高めることができる。しかし、ソフトウェアの世界では、善良なアプリケーションをいくつか誤ってブロックするアンチウイルスソフトウェアを許そうとせず、1%よりはるかに低い誤検出率を要求することが多い。従って、誤検出率が十分小さくならない場合は、誤検出があっても影響を十分小さくできるような仕組みと組み合わせる必要がある。

セキュリティ分野では結果が「説明可能」であることが望ましいが、ニューラルネットワークや深層学習などの高度な機械学習アルゴリズムは、人間が読むことのできる言葉で説明することが困難な場合が多い。

セキュリティ対策のためのAI利用に関する研究例

執筆者らは、以下のようなセキュリティ対策にAIを用いる研究を行ってきた。

それぞれについて簡単に説明を加える。

機械学習を利用した標的型攻撃用C&Cサーバの自動判別システム

近年流行している標的型攻撃では、マルウェアに感染した後にC&Cサーバとの間でさまざまな通信を行う。そのため、出口対策としてC&Cサーバのブラックリストを用い、ブラックリストに載ったサーバとの通信を制限することにより、被害の発生を防止することができる。しかし、ブラックリストは常に古いC&C情報しか持たず、新しくC&CにされてしまったC&Cサーバにアクセスしてしまう可能性がある。そこで、C&Cサーバと通常のサーバのDNS情報やWHOIS情報などを調べ、ニューラルネットワークなどのツールを使い判別モデルを作成した。そして、この手法に実データを適用しC&Cサーバの判別を行った結果、約99.3%と高い検知率を得ることができ、有効性の見通しを得ることができた。また、攻撃者に察知されにくい情報だけを用いても98.9%の検知率を上げられることが明らかになった。ここで、C&Cサーバに関する情報はVirusTotalを用いて求めた。時間経過が具体的にどのように影響を与えるかについては今後の課題である。詳しくは、(参考文献56)などを参照願いたい。

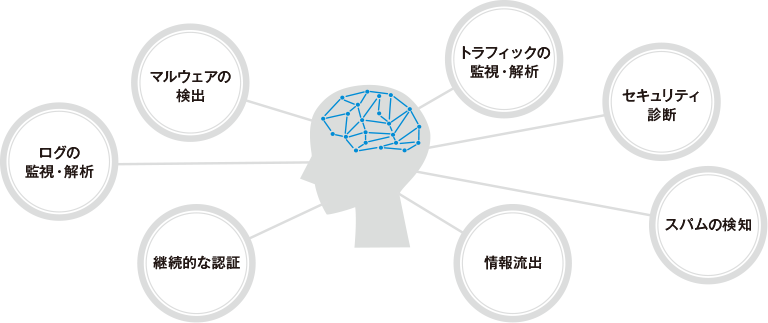

ルールベースシステムやベイジアンネットワークを利用した

知的ネットワークフォレンジックシステム

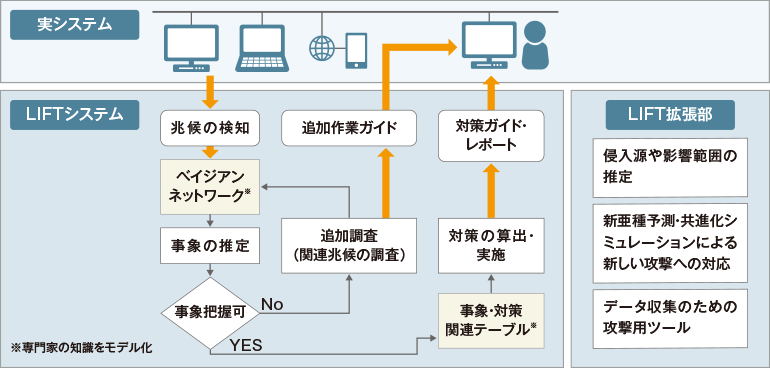

近年、企業や政府機関を対象としたサイバー攻撃の数が増加しているのはご存じのとおりである。このような組織では、標的とされた攻撃への対策を準備する必要があるが、支援システムの助けなしに攻撃中にこれらの手段を実行することは非常に困難である。そこで執筆者らは、ルールベースシステムやベイジアンネットワークなどの人工知能技術を用いて攻撃事象を推定し、攻撃対策を導くためのLIFT(Live and Intelligent Network Forensic Technologies)システムを開発した図2。このシステムは、収集されたログを分析し、攻撃の手掛かり(兆候)を検出。次にベイジアンネットワークを使用して、検出された手掛かりから各攻撃事象の可能性を推定する。確信度が十分に大きい場合、その攻撃事象が発生していると考える。確信度が小さい場合は、LIFTシステムはログからの追加の手掛かりの収集を行った上で同様の処理を確信度が十分大きくなるまで繰り返す。さらに、LIFTシステムは、攻撃事象からルールベースシステムにより対策項目を選定し、対策の実施をガイドしたり、自動操作を実行したりする。執筆者らは、LIFTシステムのプロトタイプを開発し、このプロトタイプを過去に発生した攻撃シーケンスに適用した。その結果、LIFTシステムは事象を推定したり対策を正しく指示したりという目的とする機能を実現することが確認できた。ここで、機械学習ではなくルールベースシステムやベイジアンネットワークを利用したのは、異常事象に関するデータが十分に得られないからである。このLIFTシステムについては、(参考文献78)などを参照願いたい。

図2 LIFTシステムの概要

なお、AIを応用して事象や応急対策を明確にした後、侵入元や侵入範囲を推定する必要があるが、ここでは機械学習などのAIを使わず、各機器のプロセスログとパケットログをOnmitsu(参考文献9)という執筆者らが開発したツールを用いて求め、それに機器間の接続情報を加えた上で、検知アルゴリズムに基づき侵入元や侵入範囲を推定する方法を開発している。詳しくは、(参考文献1011)などを参照願いたい。アルゴリズムを用いる方法にしたのは、このほうがアルゴリズムが正しいならば見落としがなく、推定した理由の説明が容易であり、その後具体的対策を実施するのに適していると考えたからである。このように、AIを用いる方法とアルゴリズムを用いる方法を組み合わせて利用するというアプローチも有効であると考えられる。

今後の展開

以上見てきたように、セキュリティ対策に関してもデータは十分にある。AI技術の一つである機械学習が使えるような対象は現在でも有効であり、今後も適用が増えていくと考えられる。ただし、攻撃方法は動的に変化するので適切な対応が必要となる。また、データが十分ではない対象に対しては今後さまざまな試行が必要となると考えられる。いずれにしても、AIとセキュリティに関しては重要なテーマであり上述した4つの観点から検討を続けていくことが大切であると考えられる。

今後は、攻撃側と守備側に分かれて、AI同士がお互いに戦い続けるようになっていくのだから。